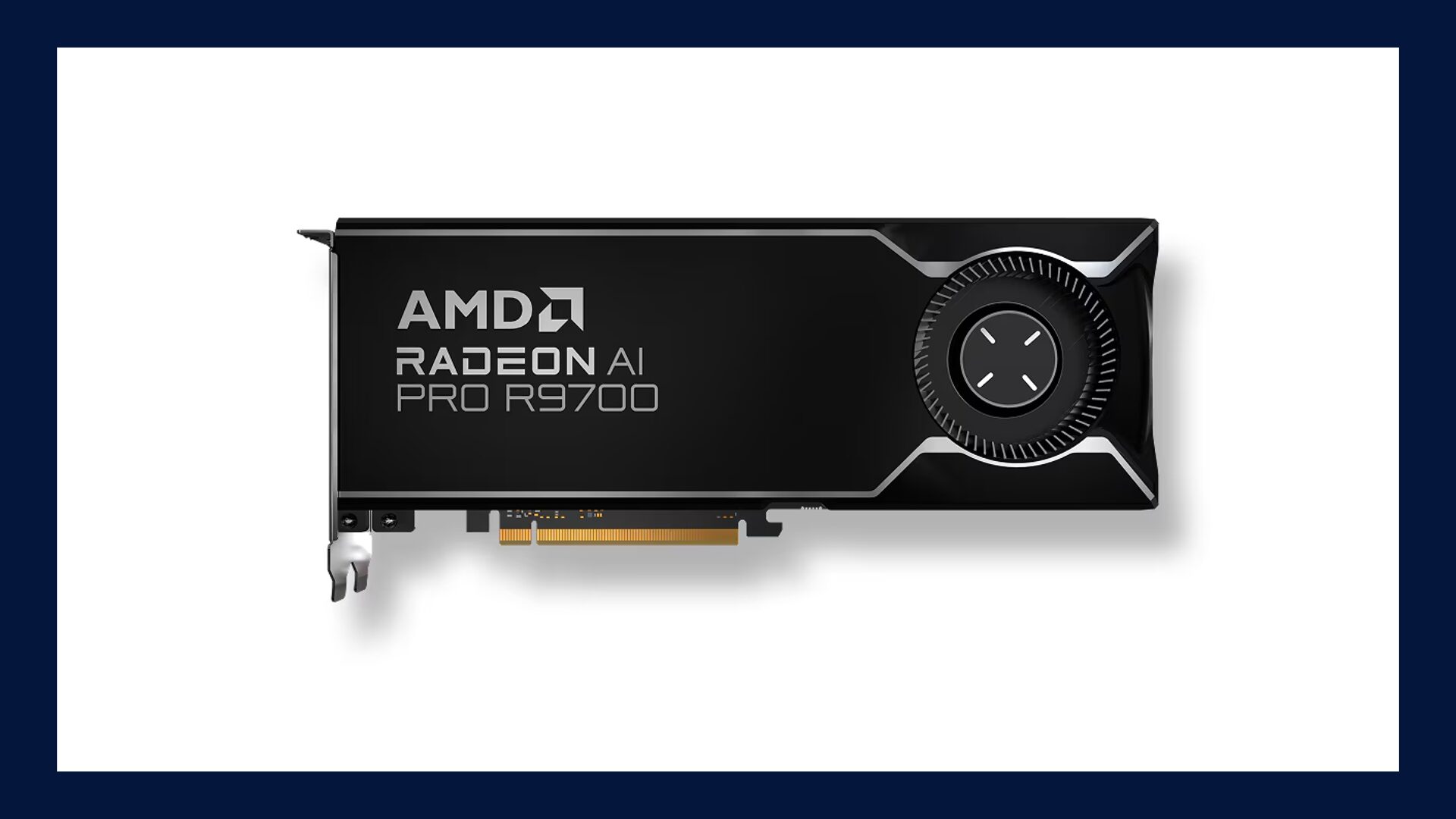

2025年10月27日、AMDがついにAI特化型ワークステーションGPU「Radeon AI PRO R9700」を全世界で店頭販売開始。

価格は1,299ドルと、プロ向けGPUとしては破格のコストパフォーマンスを実現しています。

本製品は最新世代RDNA4アーキテクチャを採用し、AIアクセラレータ128基、32GB GDDR6 VRAMを搭載した、まさに生成AI時代のためのGPU。

これまで企業向けワークステーションに組み込まれて提供されていたモデルが、ついに単体購入可能になったことで、自作ユーザー・AI開発者・クリエイターの間で大きな注目を集めています。

この記事では、Radeon AI PRO R9700のスペック・性能・AI用途でのメリット・おすすめユーザー像を、初めての方でもわかりやすく徹底解説します。

※本記事の内容は、記事更新日時点の情報をもとに作成しています。※本記事はデバイス館編集部が独自に制作しています。商品提供や広告掲載を受ける場合がありますが、ランキングや記事内容には一切影響を及ぼしていません。※また、本記事の一部においては、文章表現やイメージ画像の生成にAIツールを活用しています。

- Radeon AI PRO R9700の特徴と基本スペック

- 32GB VRAM×AIアクセラレータ128基の性能がAI用途でどう活きるか

- ROCm対応によりNVIDIAの代替として使えるのか?を徹底解説

- Stable Diffusion・LLMなどの生成AIで得られるメリット

- 4枚構成で128GB VRAMになるマルチGPU構成の利点

- どんなユーザーにR9700が最適なのかが分かる

- プロ用途・企業用途で導入する際の判断材料が得られる

Radeon AI PRO R9700とは?最新AI特化GPUの概要

2025年10月27日、AMDはワークステーション向け新GPU「Radeon AI PRO R9700」をついに単体販売として解禁しました。

価格は 1,299ドル と、プロ向けGPUとしてはやや手の届きやすい位置づけ。

これまで搭載済みワークステーションとして流通していたモデルが、いよいよ自作・増設ユーザーにも開放される形となります。

このR9700は、AMDの最新アーキテクチャ「RDNA 4」を採用したAI向けGPUで、名前の通りAIワークロードを高速処理することに特化しているのが最大の特徴。

特に、昨今重要度が急上昇している以下の用途に最適化されています。

- 大規模言語モデル(LLM)のローカル実行

- Stable Diffusion・SDXL・Fluxなどのディフュージョンモデル生成

- AIによる動画生成・画像生成・3D生成

- 企業のAI推論サーバー / データ分析ワークステーション

さらに注目すべきは、32GBの大容量GDDR6メモリを標準搭載している点。

AIモデルはメモリ容量が性能を大きく左右するため、「ミドル価格帯で32GB VRAM」というだけでもAI用途として強烈なアドバンテージがあります。

また、AMDのAI開発向けプラットフォーム ROCm にももちろん対応。

PyTorchやTensorFlowといった主要フレームワークで動作し、NVIDIAの独壇場だったAI開発環境に代替の選択肢を提供しているのも大きな強みです。

プロ用途を意識した安定性と、ローカルAI処理を高速化するパワーを備えた、「AI時代のワークステーションGPU」といえる最新モデル。

それがRadeon AI PRO R9700です。

スペック・仕様まとめ|32GB VRAM×AIアクセラレータ128基の実力

Radeon AI PRO R9700は、最新のRDNA4アーキテクチャと32GB GDDR6メモリを搭載した、まさにAI時代のために設計されたプロフェッショナルGPUです。

ストリームプロセッサ4,096基、AIアクセラレータ128基という構成により、LLM・画像生成・解析処理などの重いAIワークロードをローカルで高速実行できます。

とくに32GB VRAM・256-bitバス・640GB/s帯域というメモリ周りの強さは、大規模AIモデルの安定推論に直結。

NVIDIAの高価格帯ワークステーションGPUに迫る性能を、より手頃な価格帯で得られる点が大きな魅力です。

| 項目 | 内容 |

|---|---|

| カラー | ブラック |

| サイズ | W 111 × L 266.7 × H 39 mm |

| 重量 | 0.993kg |

| GPU | AMD Radeon AI PRO R9700 |

| アーキテクチャ | RDNA 4 |

| ストリームプロセッサ | 4,096基 |

| ゲームクロック | 最大 2,350 MHz |

| ブーストクロック | 最大 2,920 MHz |

| AIアクセラレータ | 128基 |

| レイアクセラレータ | 64基 |

| インターフェース | PCIe 5.0 x16 |

| メモリ | 32GB GDDR6 |

| メモリインターフェース | 256-bit |

| メモリ帯域幅 | 640 GB/s |

| TBP(消費電力) | 約 300W(推奨電源:750W以上) |

| 映像出力 | DisplayPort 2.1a × 4 |

| 補助電源 | 1 × 12V-2×6 |

| スロット | 2スロット |

| 冷却仕様 | ブロワーファン(デュアルボールベアリング) |

| 対応OS | Windows 10/11 64bit、Linux x86 64bit |

| 付属品 | 12V-2×6 → PCIe 8pin ×3 変換アダプター |

何ができる?Radeon AI PRO R9700が活きる用途

Radeon AI PRO R9700は、「AI処理に最適化されたRDNA4 GPU」という言葉のとおり、一般的なゲーミングGPUとは明確に用途が異なります。

特に注目すべきは、AIアクセラレータ128基と32GB GDDR6メモリの組み合わせ。

これらが合わさることで、以下のようなAI時代ならではの重いワークロードでもローカル実行が現実的になります。

- 大規模言語モデル(LLM)のローカル実行

- Stable Diffusion・SDXL・Fluxなどの画像生成AI

- 機械学習・データサイエンス用途

- プロフェッショナル向けクリエイティブ作業

- 4枚構成(128GB VRAM)での巨大AIモデル運用

R9700の最大の強みと言っても過言ではないのが、ローカルLLMの高速処理です。

Llama 3 70B(量子化版)、Qwen 2 57B、Mixtral 8×22Bといった巨大モデルの推論が、NV高級GPUレベルで実現できます。

ROCm対応でAI開発に最適化|NVIDIA代替となるか?

Radeon AI PRO R9700がAI特化GPUと呼ばれる大きな理由のひとつが、AMDのAI開発基盤であるROCm(Radeon Open Compute Platform)への本格対応です。

ROCmは、NVIDIAのCUDAに相当するAMDのオープンなAI/MLフレームワークで、PyTorch・TensorFlow・JAXといった主要機械学習ライブラリをネイティブサポートしています。

R9700はこのROCmの最新世代に最適化されており、AI推論・学習の両方をAMD環境で安定して動かせるよう設計されています。

- PyTorch / TensorFlow がそのまま動く

- AIアクセラレータ128基をフレームワーク側で最適利用

- NVIDIAよりもAIクラスタ構築が安いという優位性

- オープンプラットフォームのため拡張性が高い

4枚構成で128GB VRAMに|マルチGPUの利点

Radeon AI PRO R9700は、単体GPUとしても強力ですが、その真価が発揮されるのは最大4枚までのマルチGPU構成にしたときです。

4枚構成では、合計128GB VRAMという、一般ユーザーでは到底触れられない領域のAI環境が実現します。

まさに「AIスタジオ級のローカルGPUクラスタ」を、個人や中小企業でも構築できてしまうスペックです。

128GB VRAMの世界になると、扱えるモデルが一気に拡大します。

また、409Bなどの超巨大モデルでも分割推論(tensor parallel)を用いれば「ローカルでの部分推論」まで射程に入ってきます。

大規模AIの研究室・ベンチャーがクラウド費用を抑えて開発できる環境を自宅や小規模オフィスに構築できるのは本当に革命的です。

メモリ128GB&並列演算の恩恵で、8K〜16K画像生成、大量のControlNet併用、長尺動画生成(Runway系モデル / AnimateDiff)、高速バッチ生成といった超重量級のクリエイティブ作業が全く別次元の速度で動くようになります。

CUDA環境ほど柔軟ではないものの、ROCm対応が進んだことで、LoRA学習・軽量ファインチューニングといった用途なら十分可能です。

AI開発者にとって、学習用にクラウドを借りる頻度が減るのは大きなコスト削減になります。

GPU 4枚を束ねることで、Tensor Parallel(テンソル並列)、Pipeline Parallel(パイプライン並列)といった分散手法が使えるようになり、高負荷モデルもスムーズに動作します。

特にLLMでは、メモリ不足の解消、巨大モデルのレイヤー分割、推論スループットの向上といった恩恵を受けられ、クラウドGPU(A100/MI300)を借りずとも研究できる環境が整います。

128GB VRAM環境は、まさにクラウドGPUのローカル版。AIプロダクト開発企業、映像制作スタジオ、研究室(LLM・CV・生成AI)、クリエイター向け制作会社、AIベンチャーのPoC環境といった現場では、クラウド費用の圧縮×作業スピードの向上という圧倒的なメリットがあります。

Radeon AI PRO R9700は誰におすすめ?

Radeon AI PRO R9700は、ゲーミングGPUの延長線ではなく、AI処理・プロフェッショナル用途に特化したワークステーションGPUです。

そのため、一般的なPCユーザーというよりは、AIを業務や研究に使う人に最適化されています。

ここでは、R9700がもっとも活きるユーザー像を分かりやすくまとめました。

- ローカルでLLMを実行したいAI開発者

- Stable Diffusion / SDXL / Flux などを大量に使うクリエイター基をフレームワーク側で最適利用

- データサイエンス・研究用途のユーザー

- AIスタートアップ・中小企業の社内AIサーバー用途

- 4枚構成(128GB VRAM)で巨大モデルを扱いたい研究者

- 3D制作・建築ビジュアライゼーション・映像制作のプロ

Radeon AI PRO R9700は、32GB VRAM、AIアクセラレータ128基、ROCm対応

、4枚構成で128GB VRAM、1,299ドルの価格帯という特徴から、「AIを趣味ではなく、仕事・研究レベルで扱うユーザー」にこそ最適なGPUと言えます。

まとめ|Radeon AI PRO R9700はAI時代のコスパ最強ワークステーションGPU

Radeon AI PRO R9700は、単なるGPUではなく、AI時代のために設計されたプロフェッショナル向けハードウェアと言える存在でした。

これらを踏まえると、R9700は価格に対する性能が非常に優秀で、AIを日常的に扱うプロユーザーにとっては間違いなく最注目のGPUと言えます。

特に、以下のようなシーンではRTX 4090以上の価値を発揮する場面も多いはずです。

- ローカルLLMを70B級まで動かしたいAI開発者

- Stable Diffusion / Fluxを本気で回したいクリエイター

- 自社AIサーバーを安く構築したい企業

- クラウドのGPU代を削減したい研究者

- 大規模モデルを扱うAIスタートアップ

NVIDIA一強だったAI市場に対して、AMDが久々に本気の対抗馬を出してきた印象です。

「CUDA一択の時代は終わりつつある」そう実感させてくれるだけの完成度を備えています。

ローカルAIを強化したい人、生成AIを仕事レベルで回している人、研究用途でGPUのVRAM不足に悩んでいる人。

そうしたユーザーにとって、Radeon AI PRO R9700は間違いなく買いの一枚です。

その他のおすすめ記事

最後までご覧いただき、ありがとうございました!私個人に対する質問やご相談は@XAozameXのDMまでご連絡ください。

コメント